虚拟存储器 原理、软件实现与辅助设备研发综述

虚拟存储器是现代计算机系统中一项核心技术,它通过软硬件协同,为用户程序提供了远大于物理内存容量的连续地址空间。本文将从计算机组成原理的角度,阐述虚拟存储器的核心机制,并深入探讨其相关的软件实现与辅助设备研发进展。

一、虚拟存储器的核心原理

从计算机组成原理层面看,虚拟存储器主要建立在以下基础之上:

- 地址空间分离:系统为每个进程提供一个独立的、连续的虚拟地址空间(如32位系统的4GB空间),与物理内存的实际地址空间分离。这通过内存管理单元(MMU)实现地址转换。

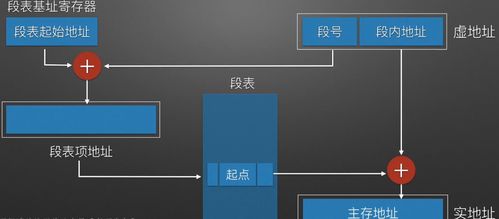

- 分页/分段机制:主流的实现方式是分页,将虚拟空间和物理空间划分为固定大小的“页”。进程的虚拟页通过页表映射到物理页帧或外存(如硬盘)的交换区。

- 按需调页:程序并非全部装入内存,只有当访问的虚拟页不在物理内存(即发生“缺页异常”)时,操作系统才从外存调入所需页面,并可能根据替换算法(如LRU)换出旧页面。

- 透明性:整个过程对应用程序完全透明,程序员看到的是统一的、巨大的虚拟地址空间。

其核心优势在于:提升多道程序并发度、简化编程模型、实现内存保护和共享。

二、虚拟存储器的软件实现

操作系统是虚拟存储器的“大脑”,其软件实现的关键模块包括:

- 内存管理模块:负责维护每个进程的页表结构(如多级页表)、处理缺页异常、执行页面置换算法。现代操作系统(如Linux的虚拟内存子系统)对此进行了高度优化,例如使用反向页表、TLB(快表)刷新策略等。

- 交换区/页面文件管理:在硬盘上划定区域(如Linux的swap分区,Windows的pagefile.sys)用于存储被换出的页面。软件需高效管理这部分磁盘空间,优化换入换出的I/O性能。

- 共享内存与写时复制:软件机制允许不同进程的页表项映射到同一物理页,实现内存共享。写时复制(Copy-on-Write)技术在进程创建时共享父进程内存空间,仅在写入时复制新页,极大提升了效率。

- 内存压缩技术:在移动设备等内存受限场景中,操作系统(如Android, iOS)会在内存紧张时,将非活动页在内存中进行压缩存储,而非直接换出到较慢的磁盘,以平衡性能与响应速度。

三、辅助硬件设备的研发演进

虚拟存储器的效率极度依赖硬件辅助,相关设备的研发是性能提升的关键:

- 内存管理单元(MMU):集成于CPU中,负责实时将虚拟地址转换为物理地址。其核心是转换后备缓冲区(TLB),作为页表项的高速缓存。研发重点在于提高TLB的容量、命中率,以及支持更复杂的页表结构(如Huge Pages以减少TLB缺失)。

- 高速缓存(Cache)的协同设计:现代CPU的Cache普遍使用物理地址索引,但访问流程需要先经过MMU转换。这带来了“别名”和“同名”等问题。硬件研发需确保Cache、TLB、页表查找流水线的高效协作,甚至引入虚拟地址Cache等设计。

- I/O内存管理单元(IOMMU):类似于CPU的MMU,为DMA设备提供地址转换和内存保护。它允许设备直接使用虚拟地址访问内存,避免了额外的复制操作,并增强了安全性(防止恶意设备访问任意内存)。IOMMU已成为高性能计算、虚拟化和安全领域的关键硬件。

- 持久性内存与存储级内存:随着非易失性内存(如Intel Optane PMem)的出现,传统内存-硬盘的二级存储层次被打破。这类设备既可字节寻址,又具有持久性。研发挑战在于如何让虚拟存储器系统将其无缝纳入管理——既可作为大容量的“慢速内存”扩展物理地址空间,也可作为极快的“持久化交换设备”,这需要操作系统内核和硬件架构的协同革新。

四、未来展望

虚拟存储器的研发正朝着更高效、更安全、更适应新型硬件(如CXL互连协议下的内存池化)的方向发展。软件层面,更智能的预取与置换算法、对异构内存的精细管理是重点。硬件层面,更紧密的软硬件协同设计、以及针对特定负载(如AI、大数据)的定制化内存管理单元将成为研发热点。虚拟存储器作为抽象层的核心地位不会动摇,但其实现形态将持续演进,以支撑下一代计算需求。

如若转载,请注明出处:http://www.hf2sdnhs.com/product/66.html

更新时间:2026-06-03 11:38:36